O que é Big Data? Conceito e para que serve

Com o avanço da internet, a quantidade de dados gerados globalmente aumentou de forma exponencial ao longo dos anos. O uso massivo de dispositivos móveis potencializou ainda mais esse crescimento diário.

Os métodos tradicionais para armazenamento e processamento de dados em grandes empresas começaram a não ser suficientes, gerando problemas e gastos cada vez maiores para suprir suas necessidades.

Devido a esses acontecimentos, surgiu o conceito de Big Data, que significa trabalhar com técnicas, ferramentas e tecnologias capazes de armazenar, processar e analisar grandes volumes de dados com velocidade e eficiência, superando as limitações dos sistemas tradicionais.

Definição de Big Data: o que significa e sua aplicação

Para entender melhor o que é o Big Data, podemos pensar na forma como esse sistema tradicional de armazenamento e processamento de dados é realizado. Vale ressaltar que o Big Data normalmente complementa, e não exclui, os métodos tradicionais de trabalho com dados.

Isso porque muitas empresas não necessitam da utilização de ferramentas do Big Data para manipular os dados, e mesmo as grandes empresas utilizam um sistema híbrido. Assim, ambos os métodos coexistem e muitas organizações adotam uma abordagem híbrida.

O sistema tradicional utiliza os famosos SGBDs, ou sistemas gerenciais de banco de dados, que guardam informações de forma estruturada, no formato de tabelas, com linhas e colunas. Utilizam máquinas com grande capacidade de armazenamento e processamento.

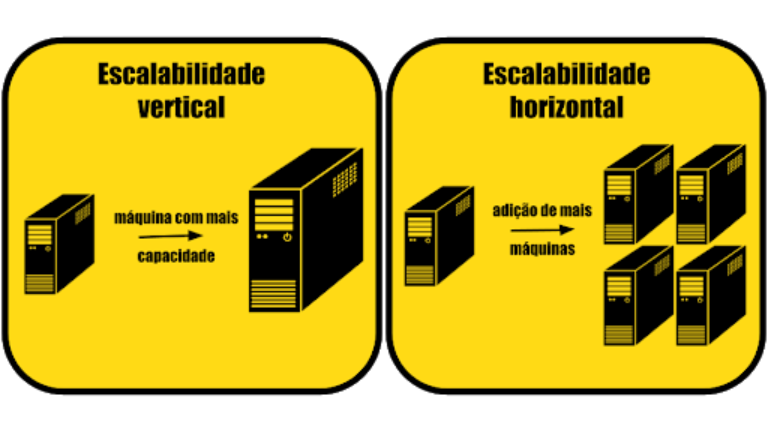

Quando há a necessidade de expandir a capacidade dessas máquinas, é necessário introduzir novos componentes de hardware, para que tenham mais memória e processamento.

Com o aumento do volume de dados nos sistemas tradicionais, surgem desafios de escalabilidade, disponibilidade e flexibilidade. Por exemplo, aprimorar essas máquinas verticalmente (adicionando mais recursos) pode ser caro e causar períodos de indisponibilidade durante manutenções ou upgrades.

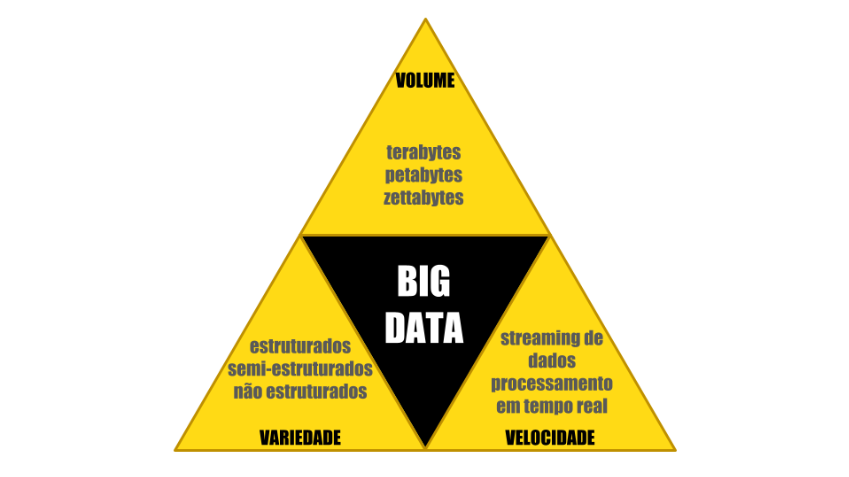

Para entender a definição de Big Data ou o que significa Big Data, é importante conhecer os chamados V’s, que caracterizam o fenômeno. Inicialmente, falava-se em 3 V’s (volume, variedade e velocidade), mas hoje muitos autores também incluem outros como valor, veracidade, variabilidade e visualização.

Mas, vamos concentrar aqui os principais dentre os 7 mencionados anteriormente, conhecidos como os três Vs do big data:

- Volume;

- Variedade;

- Velocidade;

O que é volume no Big Data?

Uma das principais características do Big Data está relacionada ao volume: a grande quantidade de dados gerados continuamente por pessoas, dispositivos e sistemas conectados, na casa de terabytes, petabytes ou mesmo zettabytes.

Há afirmações de que a quantidade de dados dobra a cada dois anos. Além disso, a quantidade de dados gerada por dia e acumulada ao longo dos anos é tão grande, que não seria interessante a colocação de valores aqui, uma vez que no momento em que você estiver lendo esse artigo esses valores já terão se alterado.

No Worldometers, é possível ter uma ideia da quantidade de dados gerados diariamente e a rapidez com que esses números estão crescendo a cada segundo. Alguns dados impactam bastante por se tratarem de valores em um intervalo de apenas 24 horas.

Já nesse vídeo denominado “Size of internet: bytes perspective”, são comparados os dados com uma escala física, mostrando a diferença entre a quantidade de dados existente na internet em 2001 e 2020.

O que é variedade no Big Data?

Outra característica importante no Big Data é a variedade dos dados que são armazenados e processados. Além dos famosos dados estruturados, o conceito de Big Data trabalha com dados semi-estruturados e não estruturados.

Os dados estruturados são os dados com estrutura rígida em formato tabular, com linhas e colunas.

Os dados semi-estruturados possuem certo tipo de estrutura, mas são mais flexíveis. Os arquivos do tipo XML e JSON são exemplos de dados semi-estruturados.

Já os dados não estruturados são dados sem nenhuma estrutura pré-definida, correspondendo à maior parcela dos dados circulantes no mundo atualmente, em uma proporção bem maior do que os demais tipos. Arquivos de texto, de áudio, vídeo e imagens, são exemplos de dados não estruturados.

O que é velocidade no Big Data?

A velocidade se refere à rapidez com que os dados são gerados. A todo instante, e-mails, mensagens de texto e áudio são enviados, tweets são publicados, registros em bancos de dados são inseridos e atualizados. Tudo isso em uma escala global.

Não podemos nos esquecer dos dados gerados por máquinas a cada instante, através de sensores e de serviços de streaming que enviam e recebem dados em uma velocidade surpreendente. Essa alta velocidade é uma das características essenciais do Big Data.

Como funciona o Big Data: aplicações e soluções

Para que fosse possível resolver os problemas que surgiram, foi necessário criar novas ferramentas para suprir todas as necessidades.

A escalabilidade vertical, na qual aprimoramos uma máquina adicionando mais recursos, como memória e processamento, não garante efetividade quando se trata de Big Data devido a limitações físicas e custos exponencialmente crescentes.

Para contornar os problemas, grandes empresas pesquisaram um novo sistema que fosse escalável, surgindo então o Hadoop, uma forma de armazenamento e processamento distribuído.

A ideia é utilizar cluster de máquinas ou agrupamento de computadores. De forma isolada, um único computador nesse cluster não tem um poder de processamento muito poderoso, mas, em conjunto, conseguem fornecer poder de processamento e armazenamento capazes de suprir as necessidades.

Nesse cluster, há uma máquina principal, chamada Name Node, responsável por gerenciar as demais, conhecidas como Data Nodes. Os dados são replicados em múltiplos Data Nodes; assim, caso uma máquina falhe, os dados continuam disponíveis, esse conceito garante a chamada alta disponibilidade.

Uma vantagem desse modelo é a facilidade de expansão: basta adicionar novas máquinas ao cluster para aumentar a capacidade, permitindo que ele cresça horizontalmente de forma praticamente ilimitada.

A partir do surgimento do Hadoop, diversas outras tecnologias foram sendo desenvolvidas em paralelo, criando assim um ecossistema de ferramentas que se expande a cada dia. Dando destaque para a utilização de bancos de dados NoSQL para trabalhar com dados não estruturados.

Como funciona o ciclo de vida?

O ciclo de vida em problemas com grandes volumes de dados é um processo que pode ser cíclico. O processo envolve diferentes etapas para gerenciar e extrair valor dos dados. A nomenclatura das fases pode variar, mas, geralmente, são adotadas as etapas de:

- Coleta;

- Armazenamento;

- Processamento;

- Análise;

- Visualização;

- Ação.

Além disso, pode ser necessário excluir dados ao final do ciclo para garantir a privacidade e atender regulamentos de proteção de informações.

Para que serve o Big Data: tipos de análise e aplicações

O objetivo na coleta e manutenção de uma grande quantidade de dados é a geração de valor. Por isso, são realizadas análises com objetivos específicos.

- Análise descritiva: nesse tipo de análise os dados são usados para descrever o que aconteceu no passado. Assim, podem ser identificados padrões, tendências e anomalias nos dados.

- Análise diagnóstica: aqui, a análise é usada para entender por que algo aconteceu. Neste caso, estamos interessados em identificar as causas de problemas que já foram notados.

- Análise preditiva: na análise preditiva estamos fazendo uma projeção do que irá acontecer no futuro com base em experiências passadas.

- Análise prescritiva: nesse caso, o foco é recomendar ações específicas a serem tomadas. Podemos usar os resultados da análise para melhorar a eficiência, a eficácia e a produtividade das empresas.

É importante observar que a escolha do tipo de análise a ser aplicada depende tanto do problema quanto dos dados disponíveis. Diferentes cenários podem exigir mais de um tipo de análise.

O que é preciso para trabalhar com Big Data?

Para quem quer atuar na área, é importante conhecer a definição de Big Data, saber o que significa o termo e entender para que serve. Assim como na Ciência de Dados, são necessárias desde habilidades técnicas até habilidades de comunicação e pensamento crítico.

No quesito técnico, as ferramentas de Big Data são muitas e podem deixar dúvidas de por onde a pessoa deve começar a estudar.

Confira a seguir, alguns elementos indispensáveis:

- O/a profissional terá que aprender pelo menos uma linguagem de programação como Python, R, Java ou Scala. Além disso, terá que estar familiarizado com frameworks como o Apache Hadoop e Spark.

- Em se tratando de Bancos de Dados, são necessários conhecimentos tanto de bancos relacionais quanto de NoSQL. Nesse caso, se torna necessário também o conhecimento de sistemas de armazenamento distribuído.

- O Hadoop é um dos principais frameworks para processamento de Big Data. Assim, torna-se vantajoso conhecer o ecossistema do Hadoop com as ferramentas MapReduce, Hive, Pig e HBase.

- Por outro lado, existem diversas plataformas na nuvem como o Google Cloud, Azure e AWS que tendem a facilitar esse processo, além de permitir o armazenamento e processamento veloz de grandes volumes de dados. A plataforma DataBricks abstrai muito do trabalho com Big Data e com as plataformas de nuvem, sendo um ótimo caminho para um primeiro contato de quem está iniciando no Big Data e já conhece alguma das linguagens de programação citadas.

Qual o grande desafio do Big Data?

O Big Data apresenta diversos desafios, mas o maior deles está relacionado ao gerenciamento do problema. Além disso, o processamento e análise de grandes volumes de dados faz com que seja necessário escolher plataformas ideais. Só assim, é possível assegurar questões como a escalabilidade e integração de informações.

O custo e infraestrutura devem ser bem analisados, pois lidar com Big Data pode ser caro, tanto em termos de infraestrutura quanto de recursos humanos. Investir em tecnologias avançadas e profissionais qualificados também é necessário para obter sucesso nessa área.

Superar esses desafios requer não só habilidades técnicas, mas também abordagens inovadoras. Vale lembrar que as soluções evoluem junto com o avanço da tecnologia e das práticas de Big Data.

Como aplicar o Big Data na sua empresa?

O processo de aplicação do Big Data pode variar de caso a caso. Se você se pergunta como funciona o Big Data dentro das empresas e para que serve na prática, saiba que ele envolve um processo cuidadoso e estratégico para aproveitar o potencial dos dados, impulsionar a tomada de decisões e otimizar processos.

Confira abaixo algumas etapas importantes para a aplicação do Big Data na sua empresa:

- De forma geral, no primeiro passo devemos definir objetivos e metas. Isso envolve identificar se o objetivo final envolve melhorar a eficiência operacional, aumentar a satisfação dos clientes ou mesmo se o foco será desenvolver produtos ou serviços mais personalizados.

- Posteriormente, deve ser avaliada a infraestrutura existente, se a empresa possui um banco de dados local ou na nuvem. Além disso, é necessário avaliar se a capacidade computacional disponível irá comportar o processamento dos dados. Na análise dos dados o processamento envolve muito mais do que o exigido por simples requisições a um banco de dados.

- Após a avaliação da capacidade de infraestrutura deve-se criar uma estratégia de dados. Verificar se a empresa já possui os dados necessários ou se será necessário adquirir informações para a solução do problema proposto. Com a conclusão dessa etapa já é possível aplicar as análises adequadas.

- Durante todo o processo é necessário garantir a segurança e privacidade dos dados.

- Além disso, em problemas de Big Data os dados não costumam ser estáticos, eles mudam com o tempo. Imagine que os seus dados envolvam a interação de clientes com uma plataforma de vendas. Os clientes irão continuar interagindo mesmo depois da data que os dados foram coletados. Por isso, é necessário monitorar e iterar sobre o mesmo problema conforme necessário.

Como aprender mais sobre Big Data

O volume de dados no mundo não para de crescer, e as empresas que sabem transformar essa informação em estratégia são as que saem na frente.

Hoje, profissionais que dominam dados são valorizados não só pela parte técnica, mas pela capacidade de gerar insights, tomar decisões e impactar diretamente os resultados do negócio.

Na Carreira em Ciência de Dados, você desenvolve exatamente esse perfil: aprende na prática, constrói projetos relevantes e se prepara para atuar em um dos mercados mais promissores da atualidade.

Comece agora e se posicione em uma área que só tende a crescer.

Resumo e próximos passos para se aprofundar

Diante de tudo que foi apresentado, foi possível compreender a importância e os conceitos iniciais, além da definição de Big Data, suas características, para que serve e como funciona na prática.

As soluções e ferramentas criadas foram essenciais para que o mundo atual esteja em constante evolução. Por se tratar de uma área muito ampla, muitos conceitos ficaram de fora desse artigo.

Caso queira expandir ainda mais os conhecimentos, a internet tem um volume muito grande de conteúdos, você pode encontrá-los em uma variedade de formatos e você vai encontrar em uma velocidade muito rápida.

Deixo aqui uma indicação de leitura do livro que dá uma ideia geral a respeito do assunto: